PyTorch入门学习:3-Gradient Descent

Gradient Descent

1 Introduction

- 穷举法局限性

- 分治法:区间内均分点,找到最优后,再在最优点的邻域内继续搜索。 易陷入局部最优解

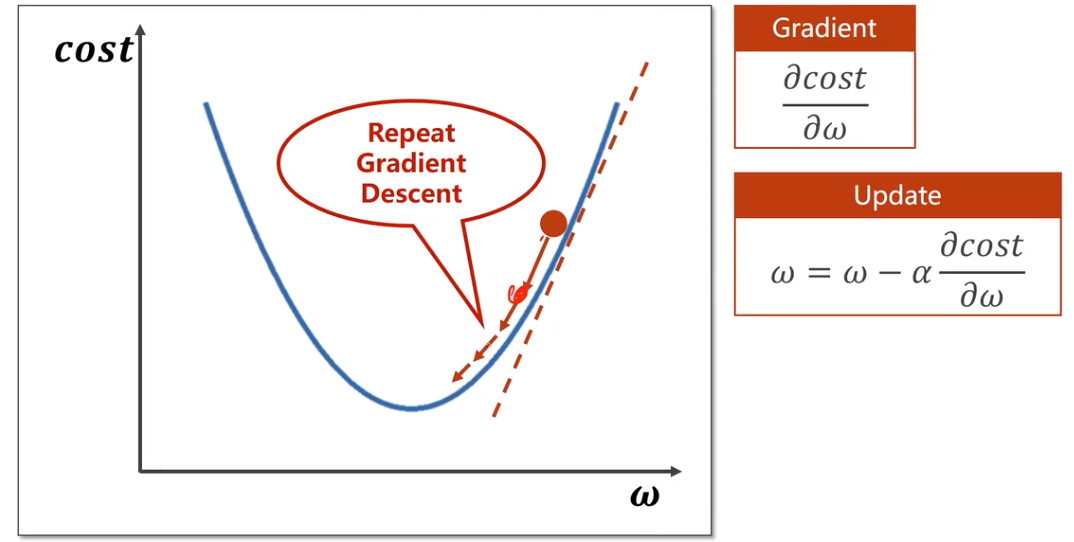

2 Gradient Descent

在点的梯度方向上取反,即可得到损失下降的方向。

- 同样难以解决非凸函数局部最优的问题

- 同时还存在鞍点的问题

3 Application

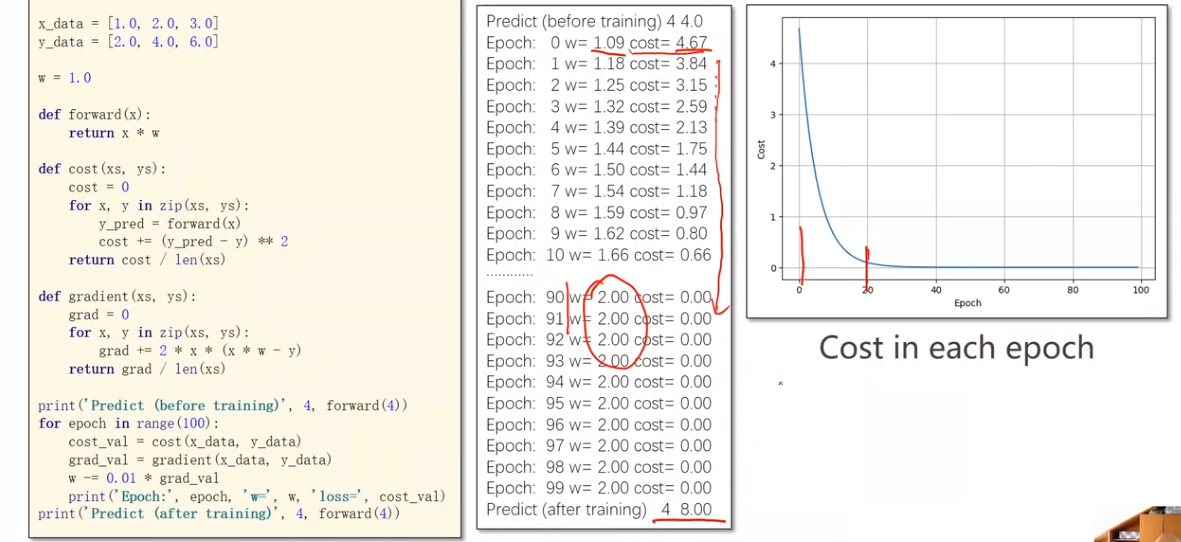

如图,损失函数的值随着迭代次数的增加而减小,并最终收敛到一个最小值点。

如图,损失函数的值随着迭代次数的增加而减小,并最终收敛到一个最小值点。

- 在实际场景中,可能遇到更复杂的情况,这时常用指数平均的方法来绘制图像。

- 若是损失函数先下降,再上升,那么常常可能是因为学习率上升。

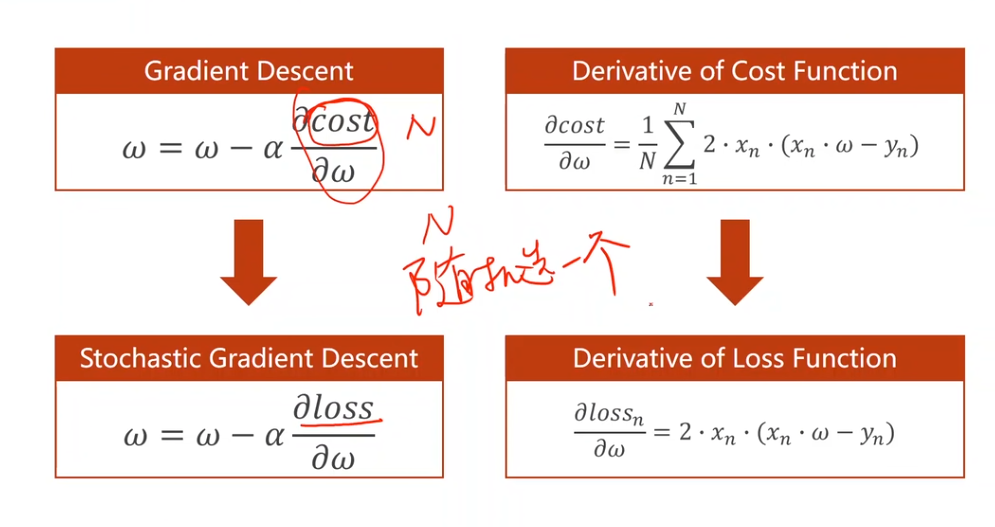

4 Stochastic Gradient Descent 随机梯度下降

区别在于从所有样本中随机选择一个样本,计算其梯度,然后更新参数。

- 引入了噪声,能够解决鞍点问题。

- 难以进行并行运算

- 折中方案:batch 批量随机梯度下降 (Mini-batch简写)

PyTorch入门学习:3-Gradient Descent

https://eleco.top/2026/02/24/learn-torch-3-Gradient-Descent-md/