PyTorch入门学习:7-Multiple Dimension Input

7 Multiple Dimension Input

1 Multiple Dimension Logistic Regression Model

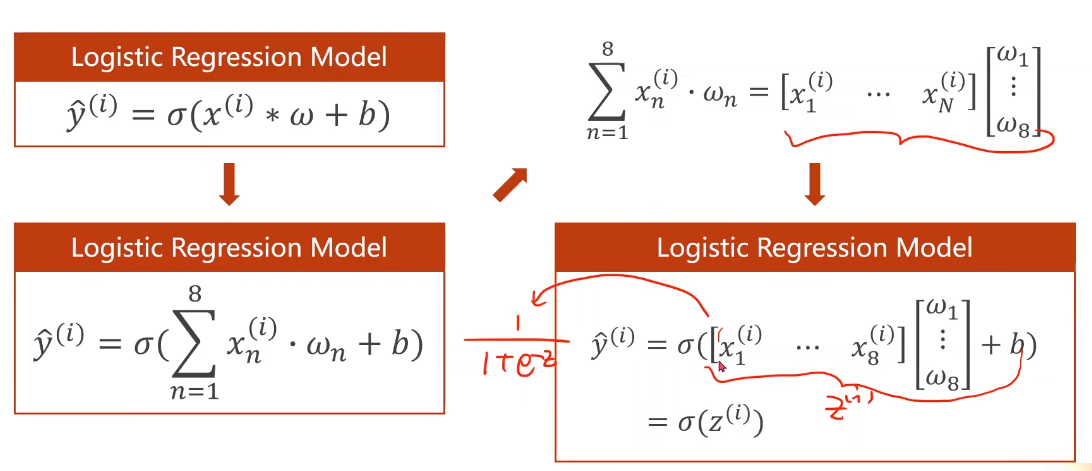

1.1 Define linear model

- Before(Logisitic Regression Model):

- Now(Multiple Dimension Logistic Regression Model):

- 公式右上角表示样本,右下角表示特征

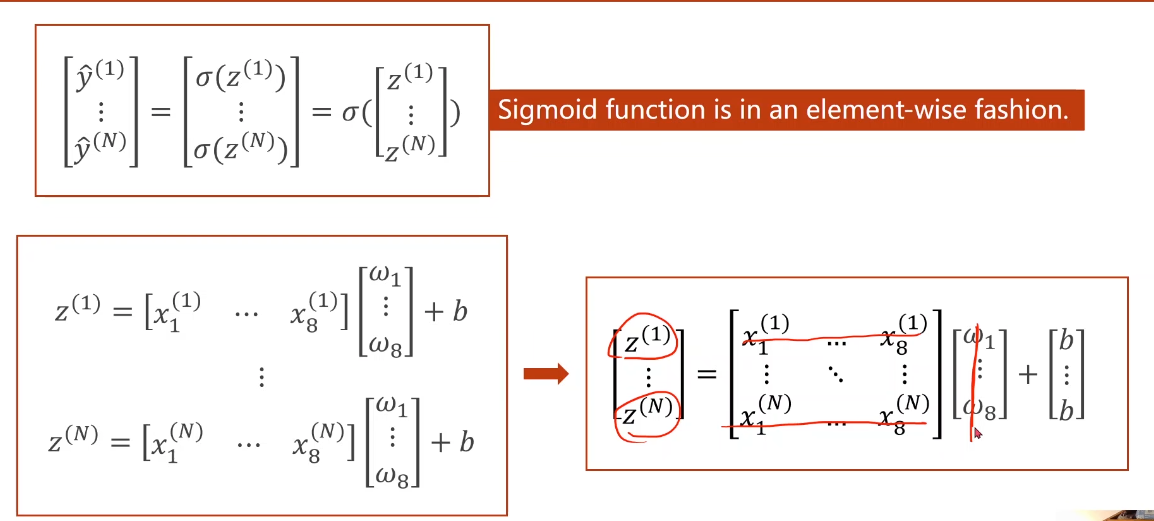

- 转换成矩阵运算,方便进行并行运算

- 使用

torch.nn.Linear(8, 1)来表示8个特征的线性组合,其实就是不同维度空间的线性映射

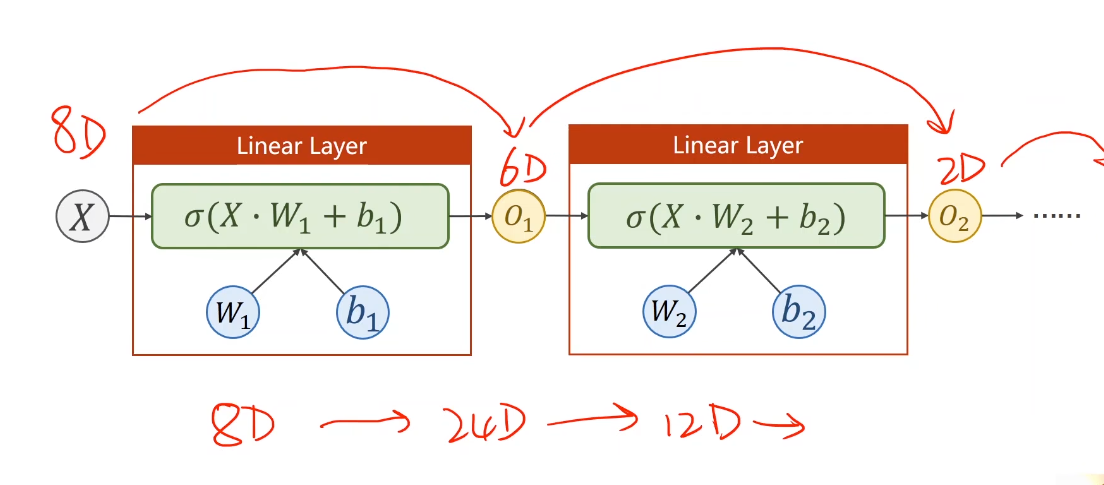

1.2 Dimension mapping & multiple layers

- 正常情况下,层数越多,对于非线性的问题,能够拟合的能力越强。但是层数太多,会导致对于噪声也被拟合的问题。因此,网络的设计可以采用超参数搜索的方式。

老师在这里提到,计算机技能最重要的是读文档和基本架构的理念,而不是死抠书本。

- 本节中将会使用8-6-4-1的网络结构作为示例。

1.3 Implementation

1 | |

2 Exercise: Try different activation functions

- 最后一层的激活函数可以使用sigmoid函数,也可以使用tanh函数。但不是所有激活函数都可以用于最后一层。

PyTorch入门学习:7-Multiple Dimension Input

https://eleco.top/2026/02/24/learn-torch-7-Multiple-Dimension-Input/